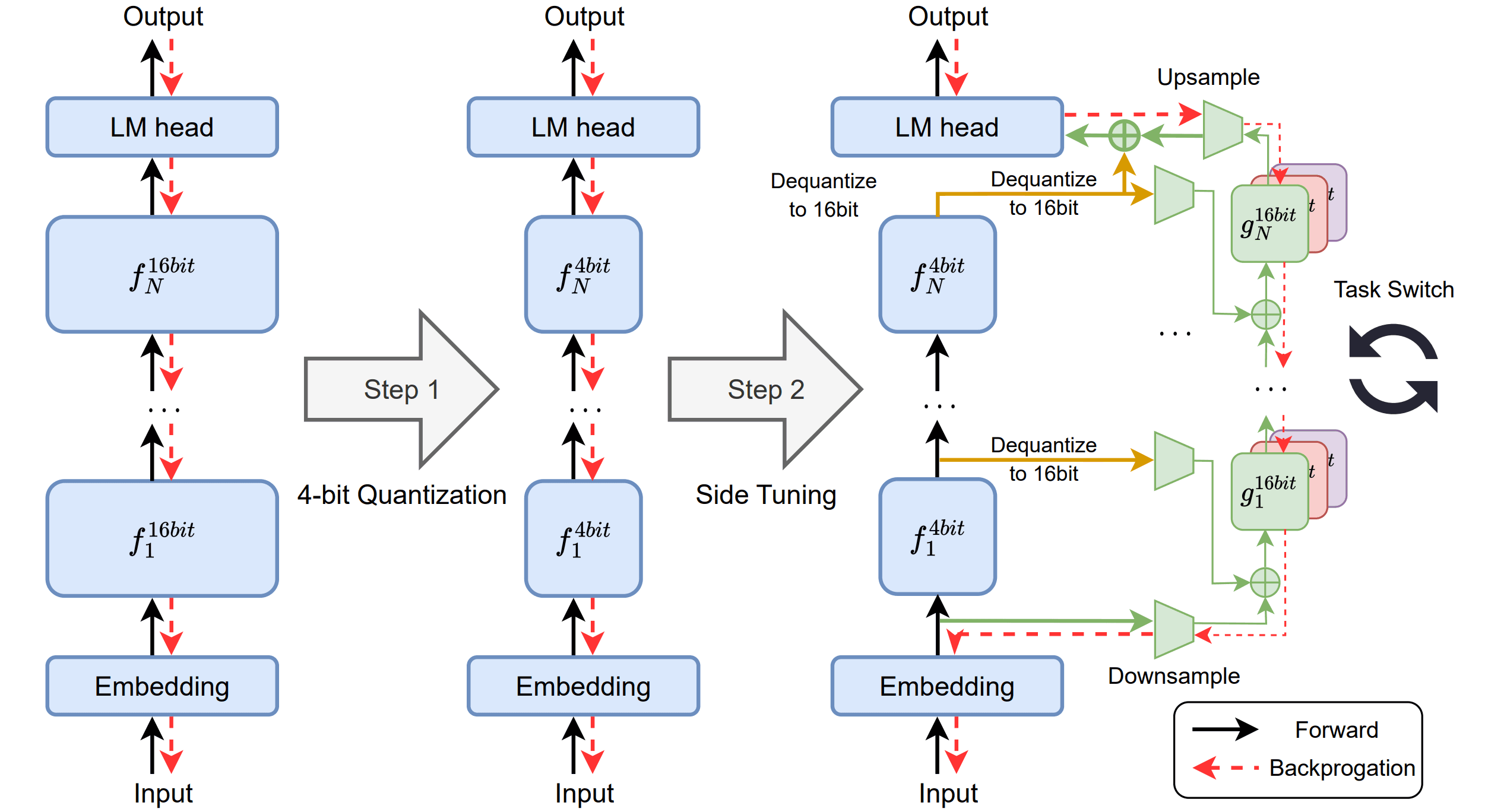

Quantized Side Tuning 논문 리뷰

Quantized Side Tuning: Fast and Memory-Efficient Tuning ofQuantized Large Language Models 논문에 대한 리뷰를 작성한 글입니다.

2025/03/11

Jinsoolve.

(46)

2025/04/27

Cross Entropy와 Softmax

2025/04/27

Word2Vec과 GloVe의 차이는 무엇일까?

2025/04/25

Batch Normalization을 하는 이유는 뭘까?

2025/02/20

삼격형의 두 변의 길이와 사잇각을 알 때, 나머지 한 변의 길이를 구하는 공식

2025/02/10

c++에서 내림차순에 대한 lower_bound와 upper_bound하기

2025/01/13

C++에서 이진수의 비트 수를 세는 방법

2025/01/13

세 점의 좌표가 주어졌을 때 삼각형의 면적 구하는 방법

2025/01/09

표준화와 정��규화

2024/12/26

로지스틱 회귀의 비용 함수는 왜 이렇게 생겼을까?

데이터 간의 순서가 중요한 데이터를 시퀀스 데이터라고 한다. 시퀀스 데이터를 처리해주기 위해서는 RNN(Recurrent Neural Network) 모델을 사용해서 처리해야 한다.

2025/01/09

차원 축소 기법에 대해서 알아보자.

2025/01/09

데이터 전처리에 대해서 정리해 보았다.

2025/01/09

머신러닝 교과서 7장의 앙상블 학습에 대해서 알아보자.

2025/01/09

자연어 처리(Natural Language Processing, NLP)의 하위 분야인 감성 분석(sentiment analysis)에 대해서 알아보는 장이다.

2025/01/09

모델 평가와 하이퍼 파라미터 튜닝의 모범 사례에 대해서

2025/01/09

왜 norm을 사용하는 것이 과대적합을 해결할까? 그 이유를 살펴보자.

2025/01/06

머신러닝에 사용하는 다양한 분류 모델들에 대해서 얘기해 보겠다.

2025/01/06

백준 17407 - 괄호 문자열과 쿼리

2025/01/01